À l’ère où le numérique ne cesse de nous étonner, donnant aux appareils des fonctionnalités de plus en plus complexes, comme la reconnaissance faciale, Google pour sa part, croit que l’apprentissage approfondi (Deep Learning), pourrait un jour remplacer un photographe professionnel. Voici ses explications.

Le « Deep Learning »

L’apprentissage par machine (ML) excelle dans de nombreux domaines avec des objectifs bien définis. Les tâches où il existe une bonne ou une mauvaise réponse permettent à un algorithme bien précis d’atteindre son objectif ; qu’il s’agisse d’identifier correctement les objets dans les images ou de fournir une traduction appropriée d’une langue à l’autre. Cependant, il existe des domaines où les évaluations objectives n’offrent pas une reproductibilité fiable. Par exemple, si une photo est belle, elle est alors mesurée par sa valeur esthétique, ce qui est un concept hautement subjectif.

Pour explorer comment ML peut apprendre des concepts subjectifs, nous avons développé un photographe virtuel expérimental de formation approfondie pour la création de contenu artistique. Il imite le flux de travail d’un photographe professionnel, recherchant, par exemple, la meilleure composition, puis effectue diverses opérations de post-traitement pour créer une image esthétiquement agréable.

Un « photographe virtuel »

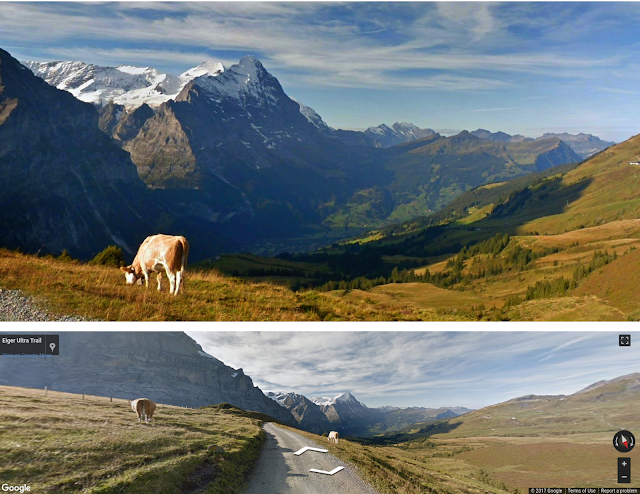

Notre photographe virtuel a «voyagé» dans des régions comme les Alpes, les parcs nationaux de Banff et Jasper au Canada, une partie de la côte californienne et dans le parc national de Yellowstone. Ce photographe virtuel est revenu avec photos impressionnantes, dont certains s’approchaient de la qualité qu’un photographe professionnel pourrait faire – comme l’ont jugé de véritables photographes professionnels.

Notre approche repose uniquement sur une collection de photos de qualité professionnelle, sans paires d’images avant / après ou de critères supplémentaires. Il décompose l’esthétique d’une photo en plusieurs parties automatiquement. En appliquant cette approche de l’apprentissage approfondi, nous pouvons améliorer une photo quant à sa composition, son niveau de saturation et son éclairage avec des optimisations qui peuvent être rapidement faites. Voici quelques exemples de photos prises par notre photographe virtuel:

Évaluation des photos

Pour juger de la réussite de notre algorithme, nous avons conçu une expérience en combinant nos créations avec d’autres photos de différentes qualités et les avons montrées à plusieurs photographes professionnels. Ils ont reçu l’ordre d’attribuer un score de qualité pour chacune d’elles, avec des critères prédéfinis :

- Un instantané sans tenir compte de la composition et de l’éclairage. (débutant)

- De bonnes photos pour des gens en général, sans connaissance en photographie. (amateur)

- De bonnes photos montrant clairement un aspect artistique et une maîtrise de concepts de base de la photographie. ( semi-pro)

- De bonnes photos prise par un professionnel maîtrisant parfaitement tous les aspects de la photographie. (pro)

Après avoir montré nos photos à des professionnels, environ 40% des notes qu’elles ont reçues se situaient à des niveaux «semi-pro» à «pro».

Travail futur

Les panoramas de Google Street View ont servi de banc d’essai pour notre projet. Un jour, cette technologie pourrait vous aider à prendre de meilleures photos. Nous avons compilé un ensemble d’images correspondant à nos critères de satisfactions. Si vous voyez une photo que vous aimez, vous pouvez cliquer dessus pour faire apparaître un panorama Street View voisin. Après avoir vu ces photos, prendriez-vous la même décision si vous étiez là avec votre appareil photo ?

Remerciements

Ce travail a été réalisé par Hui Fang et Meng Zhang de Machine Perception chez Google Research. Nous tenons à remercier Vahid Kazemi pour son travail antérieur dans la prévision des scores en utilisant le réseau Inception, et Sagarika Chalasani, Nick Beato, Bryan Klingner et Rupert Breheny pour leur aide dans le traitement des panoramas Google Street View. Nous tenons à remercier Peyman Milanfar, Tomas Izo, Christian Szegedy, Jon Barron et Sergey Ioffe pour leurs commentaires et commentaires utiles. Merci énormément à nos photographes professionnels anonymes!

crédit photo : Google